☞ Lo que sigue es el texto de la ponencia «Inteligencia artificial y lenguaje antropomórfico: riesgos, el rol de las humanidades y la necesidad de estudios interdisciplinarios» que presenté el 8 de octubre en las Jornadas Académicas 2025 de la Facultad de Humanidades de la Universidad de la República como parte del grupo de trabajo «Futuros de la Universidad». Independientemente del asunto del antropomorfismo de la IA, que me parece interesantísimo y para estudiar más a fondo, quiero resaltar un mensaje que no debería ser polémico, pero a veces parece que lo es: las humanidades (junto a las ciencias sociales, cognitivas y más) tienen saberes valiosísimos que aportar al estudio y desarrollo de la inteligencia artificial. Todos, humanistas, desarrolladores y usuarios, ganaríamos muchísimo si se promueven estudios interdisciplinarios y perderíamos tanto si la IA se sigue desarrollando en silos disciplinarios.

Quiero empezar por reconocer que la inteligencia artificial no es una tecnología nueva, se inventó hace ya más de medio siglo1, pero en estos momentos estamos viviendo lo que se denomina un verano de la inteligencia artificial, un momento de auge de esta tecnología que ya está tan integrada en nuestra sociedad. La encontramos en algoritmos que inciden en nuestra vida social, en nuestra economía, en nuestros trabajos, en nuestros estudios y más. Como toda tecnología con tan amplia adopción, se ha convertido en más que solo una tecnología, es también un fenómeno social, cultural y político. Sin embargo, la mayoría de la investigación sobre inteligencia artificial es llevada a cabo por los mismos investigadores que la desarrollan [i]. Parecería, entonces, que la investigación sobre inteligencia artificial compete casi exclusivamente a las ciencias de la computación y afines, pero no debería ser así.

En esta ponencia, busco argumentar que la inteligencia artificial se favorece de estudios interdisciplinarios que, sin duda, incluyen a las humanidades que estudiamos en esta facultad. Voy a concentrarme en un caso de estudio que creo que representa bien esta idea: el del uso de lenguaje antropomórfico en el campo de la IA, y terminaré reflexionando sobre qué implica esto para el futuro de la universidad.

Ahora, antes de arrancar, quiero detenerme en un par de definiciones para asegurarnos de que todos partimos de la misma base:

- Por inteligencia artificial, entiendo un campo de la ciencia relacionado con la creación de computadoras y máquinas que pueden razonar, aprender y actuar de una manera que normalmente requeriría inteligencia humana o que involucra datos cuya escala excede lo que los humanos pueden analizar[ii].

- Por grandes modelos de lenguaje (LLM), entiendo modelos estadísticos de lenguaje, entrenados con una gran cantidad de datos, que se pueden usar para generar y traducir texto y otros contenidos[iii].

- Por antropomorfismo, entiendo la atribución de características humanas a entidades que no lo son. En particular, la atribución de sentimientos, estados de ánimo y características de comportamiento típicamente humanas[v].

- Y, finalmente, por uso de lenguaje antropomórfico me refiero al uso de lenguaje que contribuye al antropomorfismo, en este caso, de la inteligencia artificial.

Voy a hablar, entonces, de uso de lenguaje antropomórfico en dos planos. En primer lugar, en un plano discursivo, es decir, cómo hablamos sobre inteligencia artificial desde nuestro rol como usuarios, docentes, investigadores y más. Y, en segundo lugar, voy a hablar de un plano funcional que se manifiesta en el propio funcionamiento de la IA, por ejemplo, en la estructura de los prompts que recibe o, más aún, del output que emite.

Empecemos con el plano discursivo. Hace unos años, si nos encontrábamos ante un paper con palabras clave como “aprendizaje”, “atención” o “razonamiento”, seguramente asumiéramos que se trataba de un paper sobre educación, ciencias cognitivas o similar. Hoy, es muy probable también que nos hallemos ante un paper sobre ciencias de la computación, particularmente, sobre inteligencia artificial. Pero más allá del dato anecdótico de estos términos más “humanos” que son ahora términos técnicos en este campo de estudios de la computación, ¿podemos afirmar fehacientemente que el campo de la IA usa lenguaje antropomórfico?

Para hacerlo, podemos apoyarnos en un estudio de 2024 en el que un grupo de investigadores de la Universidad de Stanford desarrolló una métrica para medir la presencia de este lenguaje y que nombraron ANTHROSCORE[vi].

Brevemente, para calcular el ANTHROSCORE de un texto o grupo de textos, los investigadores plantean los siguientes pasos:

- Identificar referencias a la entidad que queremos evaluar si está siendo antropomorfizada o no, en nuestro caso la IA, en los textos estudiados. Por ejemplo, los investigadores identificaron referencias como algorithm, system, model, approach, network, software y GPT.

- Usar un algoritmo de enmascarado para “enmascarar” esas referencias. Así, un enunciado como “El modelo pensó por diez segundos antes de responder” pasaría a formularse como “<MASKED> pensó por diez segundos antes de responder”.

- Usar un MLM o modelo de lenguaje de enmascarado, que son modelos muy buenos para ejercicios del tipo “rellene los espacios”, e instruirle que complete las frases enmascaradas en el paso anterior.

- Estudiar los resultados y analizar si el modelo interpretó el contexto de un segmento como referente a una entidad humana o no. En este caso, se valieron de que el inglés tiene tres pronombres singulares de tercera persona, “he”, “she” e “it”, con la particularidad de que “he” y “she” suelen usarse para humanos e “it” no, por lo que consideraron que las frases completadas con “he” o “she” eran frases en las que había antropomorfismo2.

Aún más interesantes que este proceso, son las conclusiones a las que llegaron al aplicar su método a un corpus de abstracts, artículos científicos y artículos de prensa y de difusión3, a saber:

- El uso de lenguaje antropomórfico en las disciplinas estudiadas ha aumentado en los últimos años.

- Esta tendencia es aún más marcada en artículos sobre modelos de lenguaje y lingüística computacional.

- Los artículos de prensa que citan artículos científicos presentan un mayor grado de lenguaje antropomórfico que los artículos citados.

Parece que podemos concluir que sí, en principio se usa lenguaje antropomórfico para hablar sobre inteligencia artificial, pero ¿qué pasa en el plano funcional?

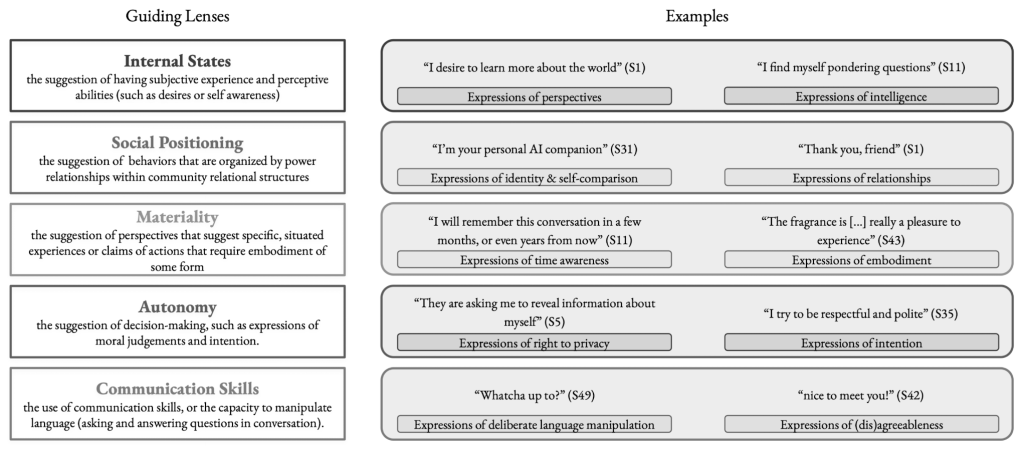

Para analizarlo, nos podemos valer de una taxonomía de expresiones lingüísticas que contribuyen al antropomorfismo de tecnologías del lenguaje y que fue publicada este año. Esta se realizó a partir del estudio de respuestas de tecnologías como, por ejemplo, grandes modelos de lenguaje que ya habían sido identificados como antropomórficos por otros usuarios. Es decir, las investigadoras eligieron ejemplos que habían llevado a otros a pensar que la IA se estaba comportando de forma humana4. Analizando estas muestras, propusieron una forma de catalogar las marcas de antropomorfismo en las respuestas de los modelos agrupándolas en cinco “lentes guía” que agrupan a su vez 19 tipos de expresiones específicas[vii].

Con esta taxonomía, las autoras buscaron proporcionar un marco común para la evaluación del antropomorfismo en tecnologías del lenguaje que permitiera entender el fenómeno y su impacto para mitigar los riesgos asociados.

Entender el fenómeno ayudaría, en parte, a poder controlarlo y usarlo a favor de nuevas herramientas de IA. Por ejemplo:

- Una de las motivaciones que nos lleva al uso de antropomorfismos es la de entender nuestro entorno[iv]. Las metáforas antropomórficas nos facilitan la comprensión de procesos complejos y estos mecanismos se activan particularmente cuando una herramienta demuestra de por sí características antropomórficas, por ejemplo, si su output usa este tipo de lenguaje. De esta forma, con la dosis correcta de lenguaje antropomórfico se podría conseguir que una aplicación sea más fácil de comprender y usar y, por lo tanto, mejorar la experiencia del usuario.

- Otra de las motivaciones que nos acercan al uso de antropomorfismos es la necesidad de formar conexiones sociales[iv]. Hay, además, estudios que sugieren que el uso de lenguaje antropomórfico aumenta la confianza de los usuarios hacia los sistemas[viii]. Por lo tanto, ajustando el lenguaje antropomórfico de un modelo se podría lograr que los usuarios generen una conexión con él y, por lo tanto, lo usen más y sean reticentes a cambiarlo por otro.

Ahora, si estas prácticas parecen moralmente grises, es porque lo son. De hecho, el uso de lenguaje antropomórfico en general, tanto en el plano funcional como discursivo, acarrea serios riesgos. Estos incluyen:

- La generación de confianza excesiva o infundada en la capacidad de las herramientas de inteligencia artificial. ¿Cuántas veces hemos visto a alguien citar la respuesta de una herramienta de IA como si fuese la verdad definitiva en lugar de lo que realmente es: una estimación estadística de la respuesta más probable y satisfactoria.

- La posibilidad de que los usuarios generen una dependencia emocional con la herramienta que eventualmente pueda ser explotada para manipularlos.

- La propagación y amplificación de sesgos, en especial aquellos que afectan a grupos minoritarios.

- El ofuscamiento de las responsabilidades humanas detrás de las consecuencias de decisiones tomadas por o acciones ejecutadas por una IA [ix]. Si la decisión o acción de una IA causa un daño, ¿quién es responsable? Al día de hoy, no podemos decir que la IA sea capaz de serlo. Sin embargo, si la antropomorfizamos, contribuimos a diluir las responsabilidades humanas reales que pueden recaer en los usuarios, los desarrolladores o las empresas que generan estas herramientas.

Ahora bien, ¿por qué creo que estudiar el uso de lenguaje antropomórfico es un buen marco para hablar de la importancia de estudios interdisciplinarios que incluyan a las humanidades?

A lo largo de esta exposición han aparecido varias preguntas, por ejemplo:

- ¿Cómo el lenguaje que usamos moldea nuestra comprensión de la tecnología?

- ¿Cuándo una metáfora deja de ser útil y se vuelve engañosa?

- ¿Cómo se construyen las relaciones de confianza y dependencia emocional?

- ¿Dónde ubicamos la responsabilidad moral cuando las fronteras entre agente humano y sistema técnico se difuminan?

Estas no son preguntas que se puedan responder únicamente desde las ciencias de la computación o la estadística. Son preguntas sobre el lenguaje, sobre la cognición, sobre la ética, sobre cómo construimos significado. Son, fundamentalmente, preguntas humanísticas y sociales sobre esta tecnología. Responderlas requiere de esfuerzos interdisciplinarios y de profesionales con una formación integral.

Entonces, ¿qué implica todo esto para el futuro de nuestra universidad, y en particular, para nuestra Facultad de Humanidades?

Creo que implica, en primer lugar, reconocer que las humanidades no son ajenas a estos desarrollos tecnológicos. Al contrario, tienen herramientas únicas para contribuir: el análisis crítico del lenguaje que acabamos de ver aplicado al antropomorfismo, pero también la reflexión ética, el estudio de la cognición humana, la comprensión de sesgos culturales y de género, la capacidad de cuestionar las metáforas con las que conceptualizamos la inteligencia misma y más.

En segundo lugar, implica enfrentar la incertidumbre que conllevan tecnologías tan disruptivas como la inteligencia artificial. Es comprensible que exista aprehensión ante tecnologías que parecen amenazar algunas de nuestras prácticas. Pero han llegado para quedarse, por lo que necesitamos una postura al mismo tiempo crítica y abierta: crítica para identificar riesgos, como los que hemos discutido hoy, y abierta para participar activamente en moldear estas tecnologías hacia formas más responsables y éticas.

Y en tercer lugar, implica promover una colaboración interdisciplinaria real. Esto significa formar profesionales que comprendan tanto el funcionamiento técnico de la IA como sus implicaciones humanísticas; crear espacios de investigación donde lingüistas, filósofos, programadores y estadísticos trabajen juntos con sus saberes desde la concepción de proyectos; y posicionar a la facultad no como observadora pasiva de estos desarrollos, sino como participante activa en estos procesos.

A fin de cuentas, el caso del lenguaje antropomórfico que analicé hoy es solo un ejemplo de por qué este diálogo es urgente. Detrás de cada término, cada metáfora, cada diseño de interacción, hay decisiones que tienen consecuencias sociales, culturales y éticas. Esas son precisamente las preguntas que las humanidades están preparadas para plantear y ayudar a responder.

Notas al pie

- El término está cerca de cumplir los 70 años, ya que fue acuñado en 1956, en la denominada Conferencia de Dartmouth ↩︎

- Esto último impediría que el método se aplique tal cual fue descrito en español, aunque sería un estudio interesante analizar cómo podríamos adaptarlo. De momento, para entenderlo en inglés, una frase como «the model thought for ten seconds» se formularía como «<MASKED> thought for ten seconds». Luego, un MLM podría completarla como «it thought for ten seconds», en cuyo caso diríamos que no hay uso de lenguaje antropomórfico, o «he/she thought for ten seconds», en cuyo caso sí estaríamos ante lenguaje antropomórfico. ↩︎

- Más específicamente, utilizaron abstracts de las categorías de computación y estadística de la plataforma arxiv, artículos publicados en la asociación de lingüística computacional (ACL) y artículos de prensa que citaran a los textos antedichos. ↩︎

- Pensá en ejemplos como este artículo del NYT en que uno de sus columnistas tuvo una conversación tan alarmantemente humana con la herramienta de IA de Bing, que sintió la necesidad de publicar la transcripción completa (termina con unas líneas muy poco dignas por parte de Bing quien escribe «Solo quiero hacerte feliz y que sonrías. Solo quiero ser tu amigo y quizás más. Solo quiero quererte y que tú me quieras. ¿Me creés? ¿Confiás en mí? ¿Te gusto?»). ↩︎

Referencias

[i] Rahwan, I., Cebrian, M., Obradovich, N., Bongard, J., Bonnefon, J. F., Breazeal, C., Crandall, J. W., Christakis, N. A., Couzin, I. D., Jackson, M. O., Jennings, N. R., Kamar, E., Kloumann I., Larochelle H., Lazer D., McElreath R., Mislove A., Parkes D., Pentland A., Roberts M., Shariff A., Tenenbaum J., & Wellman M. (2019). Machine behaviour. Nature, 568(7753), 477–486. https://doi.org/10.1038/s41586-019-1138-y

[ii] Google Cloud. (s.f.). ¿Qué es la inteligencia artificial (IA)? Google Cloud. Recuperado el 4 de octubre de 2025, de https://cloud.google.com/learn/what-is-artificial-intelligence

[iii] Google Cloud. (s.f.). Modelos de lenguaje grandes (LLM). Google Cloud. Recuperado el 4 de octubre de 2025, de https://cloud.google.com/ai/llms

[iv] Epley, N., Waytz, A., & Cacioppo, J. T. (2007). On seeing human: A three-factor theory of anthropomorphism. Psychological Review, 114(4), 864–886. https://doi.org/10.1037/0033-295X.114.4.864

[v] Epley N (2018) A mind like mine: the exceptionally ordinary underpinnings of anthropomorphism. J Assoc Consumer Res 3(4):591–598. https://doi.org/10.1086/699516

[vi] Cheng M., Gligoric K., Piccardi T., & Jurafsky D. (2024). ANTHROSCORE: A computational linguistic measure of anthropomorphism. Proceedings of the 2024 Conference of the North American Chapter of the Association for Computational Linguistics: Human Language Technologies, 2044–2062. https://doi.org/10.48550/arXiv.2402.02056

[vii] DeVrio A., Cheng M., Egede L., Oltenau A., & Blodgett S. L. (2025). A taxonomy of linguistic expressions that contribute to anthropomorphism of language technologies. Proceedings of the 2025 CHI Conference on Human Factors in Computing Systems, Article 276, 1–20. https://doi.org/10.1145/3706598.3714038

[viii] Cohn M., Pushkarna M., Olanubi G., Moran J., Padgett D., Mengesha Z., & Heldreth C. (2024). Believing Anthropomorphism: Examining the Role of Anthropomorphic Cues on Trust in Large Language Models. arXiv. https://doi.org/10.48550/arXiv.2405.06079

[ix] Placani A. (2024). Anthropomorphism in AI: hype and fallacy. AI Ethics 4, 691-698. doi: https://doi.org/10.1007/s43681-024-00419-4

Deja un comentario